(46) AI 기술 발전 이끈 행렬

인공지능(AI) 기술, 추천 알고리즘 등은 모두 행렬 연산을 기반으로 하고 있습니다. 이처럼 수학은 단순 계산을 넘어 컴퓨터와 인간의 소통을 가능하게 하는 언어이자 도구로 자리 잡고 있습니다. 따라서 행렬을 공부하는 것은 미래 기술의 핵심을 이해하고 그 발전에 동참하는 길이 됩니다.

인공지능(AI) 기술, 추천 알고리즘 등은 모두 행렬 연산을 기반으로 하고 있습니다. 이처럼 수학은 단순 계산을 넘어 컴퓨터와 인간의 소통을 가능하게 하는 언어이자 도구로 자리 잡고 있습니다. 따라서 행렬을 공부하는 것은 미래 기술의 핵심을 이해하고 그 발전에 동참하는 길이 됩니다.

단순 계산을 빠르게 하기 위해 주판 같은 수작업 도구를 사용했고, 17세기에는 블레이즈 파스칼이 덧셈과 뺄셈을 자동으로 처리할 수 있는 계산기를 발명했습니다. 이후 고트프리트 빌헬름 라이프니츠는 곱셈과 나눗셈까지 가능한 기계를 개발하며 계산 도구를 한 단계 발전시켰습니다.

19세기에는 찰스 배비지가 기계적으로 수학적 계산을 수행하고, 조건문과 반복문을 활용해 프로그래밍이 가능한 기계를 구상했습니다.

1945년에 개발된 ENIAC은 데이터를 처리하기 위해 이진법을 사용했는데, 0과 1이라는 단순한 입력 체계가 전자회로 설계를 단순화하고 연산을 빠르게 처리할 수 있게 했습니다. 이후 컴퓨터는 더 작은 크기와 강력한 연산 능력을 갖추기 위해 발전했으며, 1950년대 트랜지스터의 발명과 1960년대 집적회로(IC)의 개발로 컴퓨터는 빠른 연산과 복잡한 데이터를 처리할 수 있게 되었습니다.

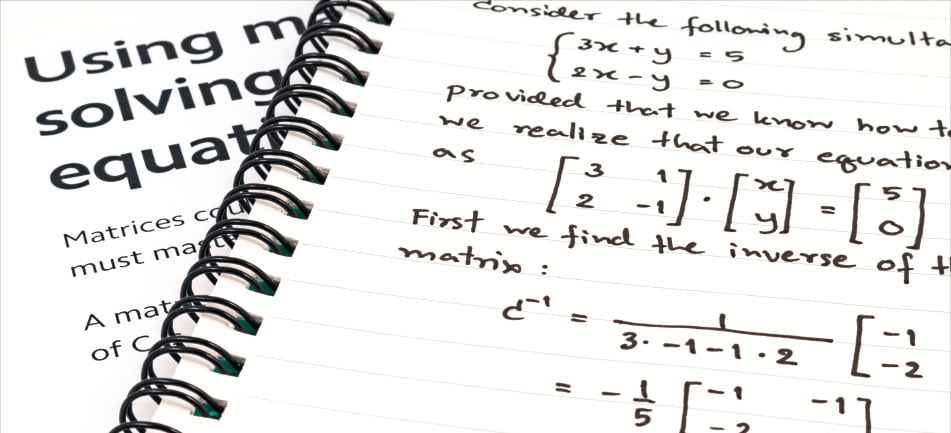

행렬은 데이터를 직사각형 배열로 정리해 복잡한 문제를 단순화하는 데 유용했으며, 이를 기반으로 프로그래밍 언어를 좀 더 쉽게 설계할 수 있었습니다. 특히 1950~1960년대에는 포트란(Fortran) 같은 고급 프로그래밍 언어를 개발함으로써 행렬 연산을 자동화하고 복잡한 계산을 간단한 명령으로 구현할 수 있게 되었습니다. 이러한 언어는 행렬 연산을 간편하게 수행할 수 있는 명령어와 구조를 제공해 과학자들이 데이터를 분석하거나 모델링하는 작업을 한결 쉽게 만들어주었습니다.

단순히 계산을 빠르게 처리하는 기계로 시작한 컴퓨터는 점차 인간의 언어, 그림, 음성을 인식하는 능력을 갖추도록 발전시키려는 시도가 이어졌습니다. 이를 위해 컴퓨터에 데이터를 입력하고 지도 학습 방식을 통해 학습시키는 방법이 사용되었습니다. 그러나 이 과정에서 데이터 부족, 연산 능력의 한계, 알고리즘의 미성숙이라는 여러 난관에 부딪혔습니다.

1980년대부터 인공지능(AI)은 암흑기(AI Winter)를 맞이했습니다. 기대와 달리 성과가 미흡하자 당시 AI 연구는 자금 지원과 관심이 급격하게 감소하면서 침체기를 겪게 됩니다. 하지만 연구자들은 데이터를 컴퓨터가 이해할 수 있는 형태로 변환하는 데 집중하기 시작했습니다.

그림은 픽셀값으로 이루어진 숫자의 집합체인 행렬로, 소리는 주파수와 시간 축을 기준으로 한 행렬로, 인간의 언어는 단어와 문장을 벡터화해 숫자의 집합체로 표현하는 방식을 도입했습니다. 이러한 방식은 컴퓨터가 시각, 청각, 언어 데이터를 분석하고 학습하는 데 필수적인 기반을 제공했습니다.

행렬의 이러한 응용은 단순히 데이터를 구조화하는 것을 넘어, 컴퓨터가 데이터를 인식하고 학습하는 데 필요한 효율적인 도구로 자리 잡았습니다. 이를 통해 딥러닝과 같은 현대 AI 기술이 발전할 수 있는 토대를 마련했으며, AI 연구는 암흑기에서 벗어나 새로운 혁신의 전환점을 맞이하게 되었습니다.

특히 인간의 언어를 학습시키기 위한 자연어처리(Natural Language Processing, NLP)는 언어를 수학적으로 다룰 수 있는 새로운 방식으로 접근했습니다. 사람의 언어를 큰 숫자 행렬로 변환해 컴퓨터가 이해하고 처리할 수 있는 형태로 표현한 것입니다. 예를 들어, 단어를 하나의 벡터로 표현하고, 이 벡터들이 모여 문장이나 텍스트의 행렬을 형성하게 됩니다.

이러한 행렬 기반 접근법은 자연어처리 기술의 비약적 발전을 이끌었으며, 오늘날의 음성 비서, 번역기, 텍스트 생성 모델과 같은 다양한 AI 응용의 기반을 형성하는 데 일조했습니다.

![수학 망친 고1 모여라🙋♂️ 중학교 베이스 없어도 살아남는 현실 조언 [재미있는 수학]](https://img.hankyung.com/photo/202605/AA.44461122.3.jpg)

!["다 맞은 문제집은 당장 버리세요!"…수포자 탈출하는 진짜 수학 공부법 [재미있는 수학]](https://img.hankyung.com/photo/202605/AA.44379310.3.jpg)

![내 폰 속 지도앱, 사실 2천년 전 수학자가 설계했다고요?👀 [재미있는 수학]](https://img.hankyung.com/photo/202605/AA.44207361.3.jpg)